Histoire de l'informatique

Cet article présente les avancées majeures dans l’évolution de l’informatique. Pour une chronologie détaillée, voir : Chronologie informatique.

|

|

Cet article ne cite pas suffisamment ses sources (décembre 2009).

Si vous connaissez le thème traité, merci d'indiquer les passages à sourcer avec {{Référence souhaitée}} ou, mieux, incluez les références utiles en les liant aux notes de bas de page. (Modifier l'article)

|

Quand on parle d’informatique, on pense souvent ordinateur. Pourtant, l’informatique existe depuis plus longtemps. Il s’agit avant tout de méthodes techniques pour améliorer le calcul. Ensuite sont apparues les manipulations de données non calculatoires, et la recherche en intelligence artificielle.

[modifier] Premiers outils

Depuis des milliers d’années, l’Homme a créé et utilisé des outils l’aidant à calculer. Au départ, la plupart des sociétés ont sans doute utilisé la main, ainsi que d’autres parties du corps, comme auxiliaires de calcul. Puis apparurent les entailles dans du bois, les entassements de cailloux, de coquillages ou d’osselets (il est intéressant de remarquer que le mot « calcul » provient du mot latin, calculi qui signifiait « cailloux »). Le premier exemple d’outil plus complexe est l’abaque, qui connut diverses formes, jusqu’au boulier toujours utilisé en Chine et en Russie. Parmi les algorithmes les plus anciens, on compte des tables datant de l’époque d’Hammurabi (env. -1750).

Vers 1617, John Napier invente une sorte d’abaque perfectionné. Son invention des logarithmes permit en 1625 à William Oughtred de développer la règle à calcul qui fut utilisée jusqu’à l’apparition des calculatrices de poche par de nombreux ingénieurs. Ainsi, par exemple, une grande partie des calculs nécessaires au programme Apollo furent effectués avec des règles à calcul.

[modifier] Premiers calculateurs mécaniques

Les premiers outils autonomes — mécaniques — apparurent au XVIe ou XVIIe siècle. Limités tout d’abord aux simples opérations d’addition et de soustraction, ils utilisaient des pignons et roues à dents d’horlogerie.

Il est difficile de dire qui créa le premier modèle de ces machines. Deux manuscrits de Léonard de Vinci, écrits vers 1500, semblaient décrire un tel mécanisme. Une analyse plus approfondie de ces manuscrits montre qu’il s’agit en fait de machines de levage. Des modèles fonctionnant ont pu être fabriqués par la suite mais il n’en reste pas de trace.

Wilhelm Schickard en 1623, dans une lettre écrite à Johannes Kepler, propose l’utilisation d’une machine décrite comme une horloge à calcul capable de « calculer immédiatement les nombres donnés automatiquement ; additionner, soustraire, multiplier et diviser, etc. », aucun exemplaire d’époque n’a été retrouvé mais il a été possible d’en construire à partir de ses descriptions.

En 1640, le jésuite hollandais Jean Ciermans mentionne dans ses Disciplinae Mathematicae un appareil à roues pour effectuer sans erreur les multiplications et les divisions mais il n’en donne aucune description.

Du fait qu’aucun modèle fonctionnel antérieur n’a pu être découvert et qu’aucun n’avait été commercialisé, on crédite en général Blaise Pascal de la création du premier calculateur mécanique : la pascaline. Le premier exemplaire fut construit vers 1642 et n’était capable d’effectuer que des additions et des soustractions.

En 1673, Gottfried Leibniz en perfectionne le principe pour la rendre capable d’effectuer des multiplications, des divisions et même des racines carrées, le tout par une série d’additions sous la dépendance d’un compteur. Leibniz inventa aussi le système binaire, système de numération qui sera approprié aux futurs ordinateurs (soit sous forme de binaire pur pour les machines scientifiques, soit sous forme de décimal codé binaire, ou DCB, pour les machines commerciales qui font plus d’entrée-sortie que de calcul). Néanmoins, jusqu’en 1945, les machines étaient encore basées sur le système décimal, plus difficile à implémenter.

À la fin du XVIIIe siècle, des machines étaient capables de réaliser un grand nombre d’opérations afin de calculer des fonctions polynomiales et de là, obtenir des tables logarithmiques et trigonométriques (par approximation polynomiale). Il est étonnant de constater que c’est précisément le développement de l’informatique qui a rendu aujourd’hui l’usage de ces tables presque inutiles.

[modifier] Premières machines programmables

La principale marque d’un ordinateur est sa programmabilité. Celle-ci permet à l’ordinateur d’émuler toute autre machine à calculer en changeant la séquence des instructions disponibles.

En 1725, Basile Bouchon, un Lyonnais, met au point un système de programmation d’un métier à tisser à l’aide d’un ruban perforé. C’était le début de la programmation. Cette invention est perfectionnée en 1728 par son assistant, Jean-Baptiste Falcon, qui utilise une série de cartes perforées reliées entre elles. Jacques de Vaucanson reprend l’idée en remplaçant ruban et cartes par un cylindre métallique perforé. On crédite souvent Joseph-Marie Jacquard de l’invention des cartes perforées, mais il ne fit que perfectionner et commercialiser le métier à tisser automatique au début du XIXe siècle.

En 1833, Charles Babbage décrivit sa machine analytique. C’était un calculateur mécanique programmable utilisant des cartes perforées comme données et fonctionnant à la vapeur. Bien que sa théorie ait été correcte, le manque de pièces mécaniques suffisamment précises et de financement public firent obstacle à la construction de cette machine. Ada Lovelace créa une série de programmes (suite de cartes perforées) pour cette machine, ses efforts firent d’elle la première programmeuse du monde.

Sur les conseils d’Herman Hollerith (qui allait créer IBM), le Bureau du recensement américain (United States Census Bureau) utilisa des cartes perforées pour le recensement de 1890.

Au XIXe siècle et XXe siècle, l’électricité permit de motoriser les calculateurs mécaniques et de remplacer certains mécanismes, par de l'électromécanique.

[modifier] L'essor de l'informatique au XXe siècle

Un survol du XXe siècle permet d'avancer plusieurs raisons à l'essor fulgurant de l'informatique :

- les progrès dans la réflexion sur les fondements de la Logique et des Mathématiques : la volonté de fonder les Mathématiques par la Logique aboutit à un échec ;

- les progrès de l'électronique ;

- la mobilisation de moyens militaro-industriels au moment de la Seconde Guerre mondiale dépasse l'ambition des programmes nationaux habituels d'aide au développement.

[modifier] Les calculateurs analogiques

Avant la Seconde Guerre mondiale, les ordinateurs analogiques, qu’ils fussent mécaniques ou électriques, étaient considérés comme le dernier cri de la technologie et beaucoup pensaient qu’ils seraient le futur de l’informatique. Ces ordinateurs analogiques utilisaient des quantités physiques, telles que la tension, le courant ou la vitesse de rotation des axes, pour représenter les nombres. Ainsi, ils devaient être reprogrammés manuellement à chaque nouveau problème. Leur avantage par rapport aux premiers ordinateurs numériques était leur capacité à traiter des problèmes plus complexes, avec une certaine forme de parallélisme.

Les calculateurs stochastiques, où la grandeur physique était remplacée par une probabilité, parurent sur le moment être l’avenir du calculateur analogique : ils étaient en effet bon marché, faciles à produire en masse, et rapides (en particulier pour les multiplications). Mais les ordinateurs numériques, plus faciles encore à programmer, remplacèrent ces ordinateurs analogiques.

[modifier] Première génération d’ordinateurs (1936-1956)

En 1936, la publication de l'article fondateur de la science informatique (en) [pdf] On Computable Numbers, with an Application to the Entscheidungsproblem par Alan Mathison Turing allait donner le coup d'envoi à la création de l'ordinateur programmable. Il y présente sa machine de Turing, le premier calculateur universel programmable, et invente les concepts de programmation et de programme.

L’ère des ordinateurs modernes commença avec les grands développements de la Seconde Guerre mondiale. Les circuits électroniques, tubes à vide, condensateurs et relais remplacèrent leurs équivalents mécaniques et le calcul numérique remplaça le calcul analogique. Les ordinateurs conçus à cette époque forment la première génération d’ordinateurs.

Vers 1954, les mémoires magnétiques (tores de ferrite pour la mémoire vive, bandes, ensuite disques amovibles puis fixes pour la mémoire de masse) supplantèrent toute autre forme de stockage et étaient dominantes au milieu des années 1970.

De nombreuses machines électromécaniques furent construites avec des capacités diverses. Elles n’eurent qu’un impact limité sur les constructions à venir.

[modifier] Les premiers calculateurs programmables

En 1937, George Stibitz construisit le premier circuit binaire, un additionneur : le Model K. K, pour Kitchen. En effet, il construisit son appareil dans sa cuisine.

En 1938, Konrad Zuse commença la construction des premières séries-Z, des calculateurs électromécaniques comportant une mémoire et une programmation limitée. Zuse fut soutenu par la Wehrmacht qui utilisa ces systèmes pour des missiles guidés. Les séries-Z furent les précurseurs de nombreuses avancées technologiques telles que l’arithmétique binaire et les nombres en virgule flottante.

Konrad Zuse mit au point cette année-là le Z1 (ou Versuchsmodell), qui ne fonctionna jamais vraiment correctement faute de crédits de développement (le Troisième Reich ne croyait guère à l’idée de Zuse).

La même année, John Vincent Atanasoff et Clifford E. Berry, de l’université de l’État de l’Iowa, développèrent l’ordinateur Atanasoff-Berry, un additionneur 16 bits binaire. Cette machine avait pour but de résoudre des systèmes d’équations linéaires. La mémoire était stockée à l’aide de condensateurs fixés à un tambour rotatif.

En novembre 1939, John Vincent Atanasoff et Clifford E. Berry achevèrent l’ABC (Atanasoff Berry Computer). Composé de lampes et de tambours pour la mémoire, il fut construit pour résoudre des systèmes d’équations linéaires. Bien que n’étant pas programmable, il était basé sur trois idées propres aux ordinateurs modernes : l’utilisation du système binaire (plus fiable et plus simple à mettre au point que le système décimal), la séparation entre le calcul et la mémoire et l’utilisation de composants électroniques plutôt que des éléments mécaniques pour réaliser les calculs. Il pouvait stocker 60 mots de 50 bits dans ses deux tambours, fonctionnait à une vitesse d’horloge de 60 Hz et réalisait 30 additions par seconde.

En 1940, George Stibitz et Samuel Williams achevèrent le Complex Number Computer (ou Model I), un calculateur à base de relais téléphoniques. Ce fut la première machine utilisée à distance via une ligne de téléphone. Il réalisait une multiplication en une minute.

En 1941, Konrad Zuse construit le Z3. Il était basé sur 2 600 relais de téléphone, lisait les programmes sur bandes magnétiques et fonctionnait parfaitement, ce qui en fit le premier ordinateur programmable fonctionnel. Il utilisait l’arithmétique binaire et les nombres à virgule flottante. Le Z3 pouvait enregistrer 64 nombres de 22 bits, avait une fréquence de 5,33 Hz et réalisait quatre additions par seconde ou 15 multiplications en une minute.

En 1944, le Harvard Mark I (ou l’ASCC, Automatic Sequence Controlled Calculator) fut mis au point par Howard H. Aiken chez IBM. C’était une machine de calcul décimal qui lisait les programmes depuis une bande de papier. Elle pesait cinq tonnes et occupait une place de 37 mètres carrés. Elle était composée de plusieurs calculateurs qui travaillaient en parallèle et réalisait trois opérations sur 23 chiffres par seconde.

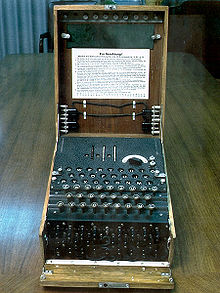

Pendant la Seconde Guerre mondiale, le Royaume-Uni fit de grands efforts à Bletchley Park pour déchiffrer les codes des communications militaires allemands. Le principal système de chiffrement allemand, Enigma (et ses différentes variantes), fut attaqué avec l’aide de machines appelées bombes, créées par les services secrets polonais et améliorées par les Britanniques, qui permettaient de trouver les clés de chiffrement après que d’autres techniques en eurent réduit le nombre possible. Les Allemands créèrent également une autre série de systèmes de chiffrement (appelés FISH par les Britanniques) très différents d’Enigma. Pour casser ces systèmes, le professeur Max Newman et ses collègues fabriquèrent Colossus ou la « bombe de Turing », il n'était pas Turing-complet bien qu'Alan Turing ait travaillé au projet. À la fin de la guerre, il fut démonté et caché à cause de son importance stratégique.

Colossus était la première machine totalement électronique, elle utilisait uniquement des tubes à vide et non des relais. Elle était composée de 2 000 tubes à vide et lisait des rubans perforés à la vitesse de 5 000 caractères par seconde. Colossus implémentait les branchements conditionnels. Neuf machines ont été construites sur le modèle Mk II ainsi qu’une dixième lorsque la seule Mk I a été convertie en Mk II. L’existence de cette machine a été tenue secrète jusque dans les années 1970 ce qui explique pourquoi de nombreuses histoires de l’informatique n’en font pas mention. Il a été dit que Winston Churchill a personnellement donné l’ordre de leur destruction en pièces de moins de vingt centimètres pour conserver le secret. Il existe actuellement un projet actif pour reconstruire une de ces machines..

[modifier] Les premiers ordinateurs

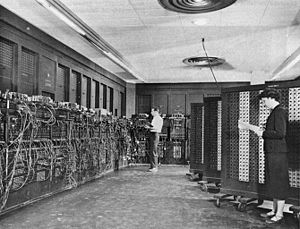

Début 1946, Presper Eckert et John William Mauchly achevèrent l’ENIAC (Electronic Numerical Integrator and Computer), qui est le premier ordinateur entièrement électronique construit pour être Turing-complet. Il avait été commandé en 1942 par l’armée américaine afin d’effectuer les calculs de balistique. L’ENIAC utilisait des tubes à vide (au nombre de 17 468) contrairement au Z3 qui utilisait des relais mécaniques. Néanmoins, il faisait ses calculs en système décimal. Malgré la véhémence de ses détracteurs qui auguraient de sa fragilité (celles des tubes à vide), il était très fiable pour l’époque et pouvait calculer plusieurs heures entre deux pannes. Physiquement c’était un monstre: il pesait plus de 30 tonnes, occupait 72 m² et consommait une puissance de 160 kW. Il tournait à 100 kHz, était composé de 20 calculateurs fonctionnant en parallèle et pouvait effectuer 100 000 additions ou 357 multiplications par seconde.

À partir de 1948 apparurent les premières machines à architecture de von Neumann : contrairement à toutes les machines précédentes, les programmes étaient stockés dans la même mémoire que les données et pouvaient ainsi être manipulés comme des données. La première machine utilisant cette architecture était le Small-Scale Experimental Machine (SSEM) construit à l’université de Manchester en 1948. Le SSEM fut suivi en 1949 par le Manchester Mark I qui inaugura un nouveau type de mémoire composée de tubes cathodiques. La machine était programmée avec le programme stocké en mémoire dans un tube cathodique et les résultats étaient lus sur un deuxième tube cathodique.

Parallèlement, l’université de Cambridge développa l’EDSAC, inspiré des plans de l’EDVAC, le successeur de l’ENIAC. Contrairement à l’ENIAC qui utilisait le calcul en parallèle, l’EDVAC et l’EDSAC possédaient une seule unité de calcul. Il utilisait un type de mémoire différent du Manchester Mark I, constitué de lignes à retard de mercure. L’EDSAC tournait à une vitesse d’horloge de 0,5 MHz.

On peut considérer que l’architecture de tous les ordinateurs actuels dérive de celle de Manchester Mark I / EDSAC / EDVAC, ils sont dit de type von Neumann.

En 1950 naquit le premier ordinateur soviétique, le MESM (МЭСМ en russe, Small Electronic Calculating Machine), sous la direction de Sergei Alexeevich Lebedev à l’institut d’Électrotechnologie de Kiev. Il était composé de 6 000 tubes à vide, consommait 25 kW et réalisait 3 000 opérations par seconde.

En février 1951, le premier modèle de Ferranti Mark I, version commerciale du Manchester Mark I et premier ordinateur commercial de l’histoire, est vendu. Il s’en vendra 9 jusqu’en 1957.

Quatre mois plus tard, P. Eckert et J. Mauchly de Remington Rand commercialisèrent l’UNIVAC I (Universal Automatic Computer). Contrairement aux machines précédentes, il ne lisait pas des cartes perforées mais des cassettes métalliques. Il possédait 5 200 tubes à vide, avait une mémoire à lignes à retard de mercure de 1 000 mots de 72 bits et consommait 125 kW. Il exécutait 8 333 additions ou 555 multiplications par seconde. 46 exemplaires furent vendus au total, à plus d’un million de dollars l’unité.

En avril 1952, IBM produit son premier ordinateur, l’IBM 701, pour la défense américaine. L’IBM 701 utilisait une mémoire à tubes cathodiques de 2 048 mots de 36 bits. Il effectuait 16 000 additions ou 2 200 multiplications par seconde. 19 machines seront installées au total.

La même année, IBM est contacté pour mettre en chantier la production des ordinateurs du réseau SAGE. Une cinquantaine de machines, portant le nom AN/FSQ7, sera produite. Chaque machine comportait 75 000 tubes, pesait 275 tonnes et consommait 750 kW.

En juillet 1953, IBM lance l’IBM 650, ordinateur scientifique comme tous ceux des séries 600 (son successeur sera le 1620). Il était composé de tubes à vide et avait une mémoire à tambour de 2 000 mots de 10 digits, mais était relativement lent. Environ 2 000 unités furent produites jusqu’en 1962. L’instabilité des résultats d’équations différentielles mise en évidence pour la première fois sur cette machine par Marion Créhange à l’université de Nancy aurait pu faire naître dès les années 1950 les questions relatives au chaos.

En avril 1955, IBM lance l’IBM 704, premier ordinateur commercial capable aussi de calculer sur des nombres à virgule flottante. L’architecture du 704 a été significativement améliorée par rapport au 701. Il utilisait une mémoire à tores de ferrite de 32 768 mots de 36 bits, bien plus fiable et plus rapide que les tubes cathodiques et les autres systèmes utilisés jusqu’alors. D’après IBM, le 704 pouvait exécuter 40 000 instructions par seconde. 123 machines seront vendues jusqu’en 1960.

[modifier] Deuxième génération (1956-1963)

La deuxième génération d’ordinateurs est basée sur l’invention du transistor en 1947. Cela permit de remplacer le fragile et encombrant tube électronique par un composant plus petit et fiable. Les ordinateurs composés de transistors sont considérés comme la deuxième génération et ont dominé l’informatique dans la fin des années 1950 et le début des années 1960. Malgré l’utilisation de transistors et de circuits imprimés, ces ordinateurs étaient encore encombrants et seulement utilisables par les universités, gouvernements et grandes sociétés. Par exemple, l’IBM 650 de 1954 composé de tubes à vide pesait 900 kg et son alimentation environ 1 350 kg, chacun enfermé dans un module de près de 2,5 m³. Il coûtait 500 000 $ ou pouvait être loué 3 500 $ par mois. De plus sa mémoire n’était que de 2 000 mots de 10 digits.

En 1955, Maurice Wilkes inventa la microprogrammation, désormais universellement utilisée dans la conception des processeurs. Le jeu d'instructions du processeur est défini par ce type de programmation.

En 1956, IBM sortit le premier système à base de disque dur, le Ramac 305 (Random Access Method of Accounting and Control). L'IBM 350 utilisait 50 disques de 24 pouces en métal, avec 100 pistes par face. Il pouvait enregistrer cinq mégaoctets de données et coûtait 10 000 $ par mégaoctet.

Le premier langage de programmation universel de haut niveau à être implémenté, le Fortran (Formula Translator), fut aussi développé par IBM à cette période. (Le Plantalkül, langage de haut niveau développé par Konrad Zuse en 1945 n’avait pas encore été implémenté à cette époque.)

En 1959, IBM lança l’IBM 1401 (commercial), qui utilisait des cartes perforées. Il fut le plus grand succès dans l’histoire de l’informatique avec 12 000 unités vendues. Il utilisait une mémoire magnétique de 4 000 caractères (étendue plus tard à 16 000 caractères).

En 1960, IBM lança l’IBM 1620 (scientifique). Il écrivait à l’origine sur des rubans perforés, mais évolua rapidement pour utiliser des lecteurs de cartes perforées comme le 1442. 2 000 unités furent vendues. Il utilisait une mémoire magnétique de 60 000 caractères décimaux. Un exemplaire opérationnel fut longtemps présent au palais de la Découverte.

En 1960, l’IBM 7000 est le premier ordinateur à base de transistors.

La même année, Digital Equipment Corporation (DEC) lança le PDP-1 (Programmed Data Processor). Le PDP-1 était le premier ordinateur interactif et a lancé le concept de mini-ordinateur. Il avait une vitesse d’horloge de 0,2 MHz et pouvait stocker 4 096 mots de 18 bits. Il effectuait 100 000 opérations par seconde. Vendu pour seulement 120 000 $ environ, il était le premier ordinateur accessible sur le simple budget d’un (gros) service sans remonter à la direction générale.

En 1960, la Société d'Électronique et d'Automatisme (SEA) commercialise la CAB500[1], véritable ordinateur personnel. Ses caractéristiques - interactivité, souplesse d'emploi, compacité et faible prix - la différencient des mainframes de l'époque. Le travail de l'utilisateur est facilité par le langage Programmation Automatique des Formules (PAF), qui traduit les fonctions explicites en langage machine. Plus d'une centaine d'exemplaires sont commercialisés, notamment dans les universités ou les écoles d'ingénieurs, et contribuent à former la première génération d'informaticiens français[2].

En 1960, les Français Serel OA-1001 [2], sortaient une machine 18 bits +signe +parité, 4 kmots, 100 kHz, purement binaire dédiée au contrôle de processus ou aux calculs scientifiques. Elle sera bientôt suivie par une version plus petite le Serel ODP-505, 3 fois plus rapide..

[modifier] Troisième génération (1963-1971)

La troisième génération d’ordinateurs est celle des ordinateurs à circuit intégré. C’est à cette date que l’utilisation de l’informatique a explosé.

En 1964 IBM annonça la série 360, première gamme d’ordinateurs compatibles entre eux et première gamme aussi à combiner par conception le commercial et le scientifique. Plus de 14 000 ordinateurs IBM 360 furent vendus jusqu’en 1970, date où on les remplaça par la série 370 beaucoup moins chère à puissance égale (mémoires bipolaires à la place des ferrites).

Toujours en 1964, DEC lança le PDP-8, machine bien moins encombrante destinée aux laboratoires et à la recherche. Il avait une mémoire de 4 096 mots de 12 bits et tournait à 1 MHz. Il pouvait effectuer 100 000 opérations par seconde. Le PDP-8 se taillera rapidement une place de choix dans les laboratoires, aidé par son langage FOCAL facile à maîtriser.

En 1966, Hewlett-Packard entra dans le domaine des ordinateurs universels (par opposition aux ordinateurs spécifiques) avec son HP-2115. Celui-ci supportait de nombreux langages, dont l’Algol et le Fortran, comme les « grands ». Le BASIC y sera adjoint plus tard.

En 1967, le gouvernement français lance le Plan Calcul destiné à assurer l’indépendance du pays en matière de gros ordinateurs.

En 1969, Data General vendit un total de 50 000 ordinateurs Nova à 8 000 $ l’unité. Le Nova était l’un des premiers mini-ordinateurs 16 bits. La version Supernova qui lui succédera en 1971 effectuait une multiplication en une microseconde, performance spectaculaire à l’époque. Le processeur principal était contenu sur un circuit imprimé de 15 pouces. Dans le même temps, grâce à une politique de mise en commun gratuite de logiciels particulièrement novatrice (et vue aujourd’hui comme l’ancêtre de l’Open Source), l’IBM 1130 se tailla la part du lion dans les écoles d’ingénieurs du monde entier.

Le circuit intégré a été inventé par Jack St. Clair Kilby en 1958. Le premier circuit intégré a été produit en septembre 1958 mais les ordinateurs l’utilisant ne sont apparus qu’en 1963. L’un de leurs premiers usages était dans les systèmes embarqués, notamment par la NASA dans l’ordinateur de guidage d’Apollo et par les militaires dans le missile balistique intercontinental LGM-30. Le circuit intégré autorisa le développement d’ordinateurs plus compacts. On les appela les mini-ordinateurs.

À noter que Philips (marque hollandaise bien connue de produits grand public) lança une série d’ordinateurs du type « 360 » pour concurrencer IBM, ils étaient plus rapides et largement aussi fiables (c’est-à-dire assez peu...) mais comme ils utilisaient un système d’exploitation spécifique, ils disparurent rapidement du marché. Siemens, Digital Equipment, HP, tentèrent également de supplanter IBM sur ce créneau du « 360 » mais sans grand succès. Seuls Control-Data et Cray purent rivaliser avec les hauts de gammes d’IBM dans les années 70-80.

[modifier] « Mini-ordinateurs », à partir de 1973

Le mini-ordinateur a été une innovation des années 1970 qui devint significative vers la fin de celles-ci. Il apporta la puissance de l’ordinateur à des structures décentralisées, non seulement grâce à un encombrement plus commode, mais également en élargissant le nombre de constructeurs d’ordinateurs. DEC devint dans les années 1980 le deuxième fabricant d’ordinateurs derrière IBM (avec un chiffre d’affaire représentant le cinquième de celui-ci) grâce à ses ordinateurs populaires PDP (surtout le PDP-11, première machine de DEC à utiliser des mémoires de 16 bits et non de 12, et machine sur laquelle et pour laquelle fut développé le langage C) et VAX, qui apportera le confort du système VMS.

L’intégration de circuits intégrés à grande échelle conduisit au développement de processeurs très petits, comme celui qui analyse les données de vol dans les avions F14A Tomcat de l’US Navy. On ignorait alors encore que l’explosion à distance d’une charge nucléaire les rendrait instantanément inopérants (effet EMP).

En 1973, le TV Typewriter de Don Lancaster permit le premier d’afficher des informations alphanumériques sur une télévision ordinaire. Il était composé de 120 $ de composants électroniques, incluait deux cartes mémoires et pouvait générer et stocker 512 caractères. Une cassette optionnelle fournissait une capacité de 100 pages de textes supplémentaires. Clive Sinclair se basera plus tard sur cette approche pour construire son Sinclair ZX80.

Dans les années 1970, IBM a sorti une série de mini-ordinateurs.

La série 3 : 3/6, 3/8, 3/10, 3/12, 3/15.

Ensuite, dans les années 1980, la série 30 : 32, 34, 36, 38.

Une troisième série a succédé à la série 30 : les AS/400.

[modifier] Quatrième génération (1971 à la fin des années 1980)

Une définition non universellement acceptée associe le terme de quatrième génération à l’invention du microprocesseur par Marcian Hoff. En pratique et à la différence des autres changements de génération, celui-ci constitua plus une évolution (presque passée inaperçue) qu’une révolution : les circuits s’étaient miniaturisés de plus en plus depuis l’invention du circuit intégré, ils continuaient simplement à le faire comme par le passé.

C’est pour cette raison que certains considèrent que les générations sont devenues des questions de type de logiciel :

- première génération : codage machine direct en binaire ;

- deuxième génération : langage assembleur ;

- troisième génération : langages évolués (Fortran, COBOL, Simula, APL, etc.) ;

- quatrième génération : langages évolués de deuxième génération comme Pascal et C++, dit « structurés », apparition des langages « Objets » et langages d’interrogation de très haut niveau comme SQL ;

- un projet de cinquième génération japonaise avait été lancé par le MITI au tout début des années 1980. Il devait être articulé sur les moteurs d’inférence et le langage Prolog, mais en dépit de budgets importants le projet n’aboutit pas.

[modifier] Les microprocesseurs

Le 15 novembre 1971, Intel dévoile le premier microprocesseur commercial, le 4004. Il a été développé pour Busicom, un constructeur japonais. Un microprocesseur regroupe la plupart des composants de calcul (horloge et mémoire mises à part pour des raisons techniques) sur un seul circuit. Couplé à un autre produit, la puce mémoire, le microprocesseur permet une diminution nouvelle des coûts. Le 4004 ne réalisait que 60 000 opérations par seconde, mais la puissance de ses successeurs répondit à la loi de Moore.

[modifier] Les super-calculateurs

Les superordinateurs intégrèrent aussi des microprocesseurs. En 1976, le Cray-1 fut développé par Seymour Cray, qui avait quitté Control Data en 1972 pour créer sa propre compagnie. C’était l’un des premiers ordinateurs à mettre en pratique le traitement vectoriel, qui appliquait la même instruction à une série consécutive d’opérandes (évitant ainsi des coûts de décodage répétés). Le Cray-1 pouvait calculer 150 millions d’opérations à virgule flottante par seconde. 85 exemplaires furent vendus à cinq millions de dollars l’unité. Parmi ses clients en France :

- l’École polytechnique (simulations et calculs numériques) ;

- Michelin (étude de résistance des pneumatiques par la méthode des éléments finis) ;

- Peugeot (simulations intensives de déformations de l’habitacle d’une voiture en cas de choc frontal ou latéral).

[modifier] Les contrôleurs de communication

Eux aussi bénéficièrent de l’usage des microprocesseurs et l’on peut même dire que la généralisation des réseaux informatiques n’a été possible que par l’invention des microprocesseurs. Les contrôleurs 3745 (IBM) utilisaient intensivement cette technologie. Dans le même temps, aux États-Unis, la compagnie AT&T se rendit compte qu’avec tous ses standards téléphoniques interconnectés, elle se trouvait sans l’avoir cherché disposer du plus grand réseau d’ordinateurs des États-Unis (un standard téléphonique, depuis l’invention des microprocesseurs, tient beaucoup plus de l’ordinateur que du dispositif câblé, et nombre d’entre eux se commandent en UNIX).

[modifier] L’ordinateur personnel

Au Sicob 1973, est apparu un micro-ordinateur allemand. Le DIEHL Alphatronic. Il comprenait une unité centrale équipée d’un Intel 8008 (4 ko extensible à 16 ko), d’un lecteur enregistreur de mini-cassette magnétique et d’une imprimante à boule IBM. Il ne comportait pas d’écran. La programmation en mini-basic était visualisée sur une mini imprimante (bande papier en rouleau). Prix de vente de l’ensemble 4 573 €.

Au même Sicob, est présenté le premier micro-ordinateur français, le Micral conçu par François Gernelle de la société R2E dirigée par André Truong Trong Thi. Il utilise lui aussi le microprocesseur Intel 8008.

La machine ne survécut pas au rachat de R2E par Bull.

En janvier 1975, sort l’Altair 8800. Développé par des amateurs, frustrés par la faible puissance et le peu de flexibilité des quelques ordinateurs en kit existant sur le marché à l’époque, ce fut certainement le premier ordinateur personnel en kit produit en masse. Il était le premier ordinateur à utiliser un processeur Intel 8080. L’Altair inaugura le bus S-100. Ce fut un énorme succès et 10 000 unités furent vendues. C’est l’Altair qui inspira le développement de logiciels à Bill Gates et Paul Allen, qui développèrent un interpréteur BASIC pour cette machine. En 1975 sortira aussi l’IBM 5100, machine totalement intégrée avec son clavier et son écran, qui se contente d’une prise de courant pour fonctionner.

Toujours en 1975, le fabricant de terminaux programmables TRW se rend compte que son terminal Datapoint 2200 à disquettes (de huit pouces) est un ordinateur si on l’équipe d’un langage évolué (BASIC) et d’un système d’exploitation (CP/M), et commence à le commercialiser comme tel, en inventant le premier réseau local pour micros : ARCnet. Ce système, commercialisé en France par Matra, ne sera cependant jamais proposé au grand public.

Le processeur Intel 8080 mena à la première vague d’ordinateurs personnels, à la fin des années 1970. La plupart d’entre eux utilisait le bus S-100 et le système d’exploitation CP/M-80 de Digital Research. CP/M-80 était le premier système d’exploitation à être utilisé par plusieurs fabricants d’ordinateurs différents, et de nombreux logiciels furent développés pour lui. Le système MS-DOS de Microsoft, acheté par Microsoft à Tim Paterson de la société Seattle Computer Products (qu’il avait appelé QDOS pour Quick and Dirty Operating System) s’en inspira fortement (en inversant l’ordre de certains opérandes pour ne pas encourir de procès, ce qui provoqua quelques catastrophes chez ceux qui utilisaient les deux systèmes).

De nombreux amateurs tentèrent à cette époque de créer leurs propres systèmes. Ces passionnés se rencontraient lors de réunions au Homebrew Computer Club, où ils montraient leurs réalisations, comparaient leurs systèmes et échangeaient des plans ou des logiciels. Certains de ces amateurs s’intéressaient à construire quelque chose de prêt à l’emploi que Monsieur tout le monde puisse s’offrir. En 1976, Steve Wozniak, qui fréquentait régulièrement le Homebrew Computer Club, conçut l’Apple I, doté d’un processeur MOS Technology 6502 à 1 MHz. Il vendit avec Steve Jobs environ 200 machines à 666 $ l’unité. Il est doté d’un microprocesseur et d’un clavier.

L’Apple II sortit en 1977. Malgré son prix élevé (environ 1 000 $), il prit rapidement l’avantage sur les deux autres machines lancées la même année, le TRS-80 et le Commodore PET, pour devenir le symbole du phénomène de l’ordinateur personnel. D’une très grande qualité, l’Apple II avait de gros avantages techniques sur ses concurrents : il avait une architecture ouverte, un lecteur de disquettes, et utilisait des graphismes en couleur. Grâce à l’Apple II, Apple domina l’industrie de l’ordinateur personnel entre 1977 et 1983. Plus de deux millions d’Apple II furent vendus au total.

En 1978, devant le succès de l’Apple II, IBM décida de renouer avec le marché de l’ordinateur personnel (le marché avait trouvé le 5100 trop lent, le 5110 trop lourd physiquement, et le System 23 Datamaster — créé pour faire pendant au TRW-2200 — n’avait pas bénéficié d’un support marketing suffisant à l’époque). Frank Cary confia une équipe, un budget et donna carte blanche à Don Estridge. En août 1981 sortit l’IBM PC (Personnal Computer). Il utilisait un processeur Intel 8088 tournant à 4,77 MHz et pouvait faire tourner trois systèmes d’exploitation différents : PC-DOS, CP/M-86 et PC/IX. L’UCSD p-System sera également utilisable, mais non supporté par IBM. Microsoft s’est réservé, contre réduction de la facture à IBM, le droit de commercialiser sa propre version du PC-DOS pour d’autres ordinateurs de marque non-IBM, et qui sera nommée le MS-DOS. Cela se révèlera une erreur monumentale pour IBM.

L’ordinateur le plus vendu de tous les temps[réf. nécessaire] fut sans doute le Commodore 64, dévoilé par Commodore International en septembre 1982. Il utilisait un processeur MOS Technology 6510 à 1 MHz et coûtait 595 $. Il avait un écran 16 couleurs et possédait une carte son. Entre 17 et 25 millions d’unités furent vendues jusqu’en 1993.

Après le 64, Commodore sortit l’Amiga. Ses possibilités exceptionnelles en matière de graphisme et la rapidité de son processeur permettaient de programmer des jeux, en particulier en utilisant le langage Amos.

À cette époque apparurent les premiers « clones » compatibles, comme le Franklin 1000 compatible avec l’Apple II ou le premier PC compatible lancé par Compaq en mars 1983. Cette concurrence sur le marché des ordinateurs personnels permit de faire baisser les prix et de rendre ces machines populaires.

En 1982, Intel lança le 80286, et IBM le PC/AT basé dessus. C’est à cette époque que le PC devint l’architecture dominante sur le marché des ordinateurs personnels. Seul le Macintosh d’Apple continua à défier l’IBM PC et ses clones, qui devinrent rapidement le standard.

En 1983, Apple lance le Lisa, le premier ordinateur personnel doté d’une interface graphique. Le Lisa utilisait un processeur Motorola 68000, un disque dur de 5 Mo, deux lecteurs de disquette et 1 Mo de RAM. Son interface graphique s’inspirait de celle du Xerox Star. Malgré son caractère révolutionnaire pour l’époque, ce fut un échec commercial, principalement à cause de son prix élevé (10 000 $) et de sa relative lenteur.

Le 22 janvier 1984, Apple lance le Macintosh, le premier micro-ordinateur à succès utilisant une souris et une interface graphique. Il reprenait plusieurs caractéristiques du Lisa, comme le processeur Motorola 68000, mais pour un prix bien plus abordable : 2 500 $, grâce à l’abandon de quelques fonctionnalités du Lisa comme le multitasking. Il était fourni avec plusieurs applications utilisant la souris, comme MacPaint et MacWrite.

Malgré ses nombreuses innovations dans le domaine, Apple perdit peu à peu des parts de marché pour se stabiliser à environ 4 % des ventes d’ordinateurs dans les années 2000. Et ce, malgré le succès de l’iMac, premier ordinateur conçu par des designers, qui s’écoula à plus de six millions d’exemplaires, en en faisant le modèle d’ordinateur personnel le plus vendu au monde. Parallèlement, le PC Compatible s’imposa de plus en plus au grand public avec des assembleurs tel que Hewlett-Packard, Compaq, Dell ou NEC.

[modifier] Années 1990

Les années 1990 ont été marquées par la correction du problème de l'an 2000 (ou bogue de l'an 2000, appelé Y2K dans le monde anglo-saxon), qui affectait presque tous les ordinateurs. En effet, la date système ne gérait que deux caractères pour l'année (99 pour 1999), de sorte qu'au passage à l'an 2000, la date système allait revenir à 00 et être interprêtée comme 1900. Ce défaut de conception systémique se manifestait également dans la plupart des logiciels, dont les sous-programmes de gestion de date reprenaient la date système le plus souvent sans modification du format[3].

La résolution de ce problème s'est faite soit par la conversion des logiciels, sans changement du matériel, soit aussi par le remplacement complet du matériel et du logiciel, en profitant des progrès techniques de diminution de taille des ordinateurs rendus possibles par la miniaturisation des composants (downsizing). Cela a permis de remplacer les logiciels spécifiques affectés par le problème, par des logiciels ou des progiciels le plus souvent sous UNIX avec des ordinateurs de taille réduite.

Cette décennie a aussi été marquée bien sûr par le développement de l'Internet et l'apparition de la Toile. La convergence de l'informatique, de l'Internet, et des télécommunications a donné lieu à l'apparition d'une nouvelle expression, les « technologies de l'information et de la communication » (TIC), que la DGLFLF préfère appeler techniques de l'information et de la communication[4], afin d'éviter l'usage abusif du mot technologie[5]. Avec Internet s'ouvre une nouvelle page de l'histoire de l'informatique.

[modifier] Notes

- ↑ [1]

- ↑ P. Mounier-Kuhn, L’Informatique en France, de la seconde guerre mondiale au Plan Calcul. L’émergence d’une science, Paris, PUPS, 2010, ch. 3 et 4.

- ↑ [pdf] Le bogue de l'an 2000, la lettre d'ADELI no36, juillet 1999

- ↑ Voir le vocabulaire des techniques de l'information et de la communication sur le site de la DGLFLF

- ↑ Consulter le résumé introductif de l'article technologie pour saisir la distinction entre technologie et technique

[modifier] Voir aussi

[modifier] Articles connexes

- Chronologie informatique

- Chronologie des langages de programmation

- Musée de l'informatique

- Histoire d'Internet

[modifier] Liens externes

Chronologie

Essais

- Histoire de l'informatique par François Guillier, mise en ligne 1996.

- L’histoire de l’informatique par Serge Rossi, mise en ligne 1996.

Musées

- Musée de l'informatique à Paris, France, ouvert en avril 2008.

- Musée de l’informatique en Suisse

Collections d'articles

- 106 fiches sur l'Histoire de l’informatique

- Historique de l’informatique dans le système éducatif français (1950 à IPT compris)

[modifier] Bibliographie

- Philippe Breton, Une histoire de l’informatique. Paris, Éditions du Seuil (coll. Points Sciences), 1990

- Paul Chion, Histoire de l'informatique, Éd. PEMF

- Jean-Yvon Birrien, Histoire de l'informatique, collection Que sais-je, no2510, Éd. PUF

- René Moreau, Ainsi naquit l’informatique, Dunod, 1984.